DeepSeek выпустил конкурента Сlaude, ChatGPT и Gemini

#DeepSeek#Искусственный Интеллект

DeepSeek выпустил конкурента Сlaude, ChatGPT и Gemini

24.04.2026

Мирослава Андреева

#DeepSeek#Искусственный Интеллект

DeepSeek выпустил конкурента Сlaude, ChatGPT и Gemini

24.04.2026

Мирослава Андреева

Китайский ИИ-стартап DeepSeek опубликовал превью новой линейки языковых моделей. Флагманская V4-Pro обошла Claude Opus 4.6 и GPT-5.4, став лучшей открытой системой.

🚀 DeepSeek-V4 Preview is officially live & open-sourced! Welcome to the era of cost-effective 1M context length.

— DeepSeek (@deepseek_ai) April 24, 2026

🔹 DeepSeek-V4-Pro: 1.6T total / 49B active params. Performance rivaling the world's top closed-source models.

🔹 DeepSeek-V4-Flash: 284B total / 13B active params.… pic.twitter.com/n1AgwMIymu

Архитектура и масштаб

V4-Pro насчитывает около 1,6 трлн параметров, но на каждом шаге использует только 49 млрд. У второй версии — V4-Flash — общий масштаб составляет 284 млрд, из которых активируются 13 млрд.

Обе модели построены на архитектуре «смеси экспертов» (Mixture of Experts, MoE): при обработке каждого токена включается только та часть подсетей, которая релевантна задаче. Такой подход дешевле полностью плотных архитектур, но не уступает им в производительности.

Предобучение проходило на корпусе объемом более 32 трлн токенов. Затем разработчики дообучили модели поэтапно, выделив отдельные блоки для кодинга, математики, логики и следования инструкциям. Финальная версия сводит эти навыки воедино с помощью дистилляции.

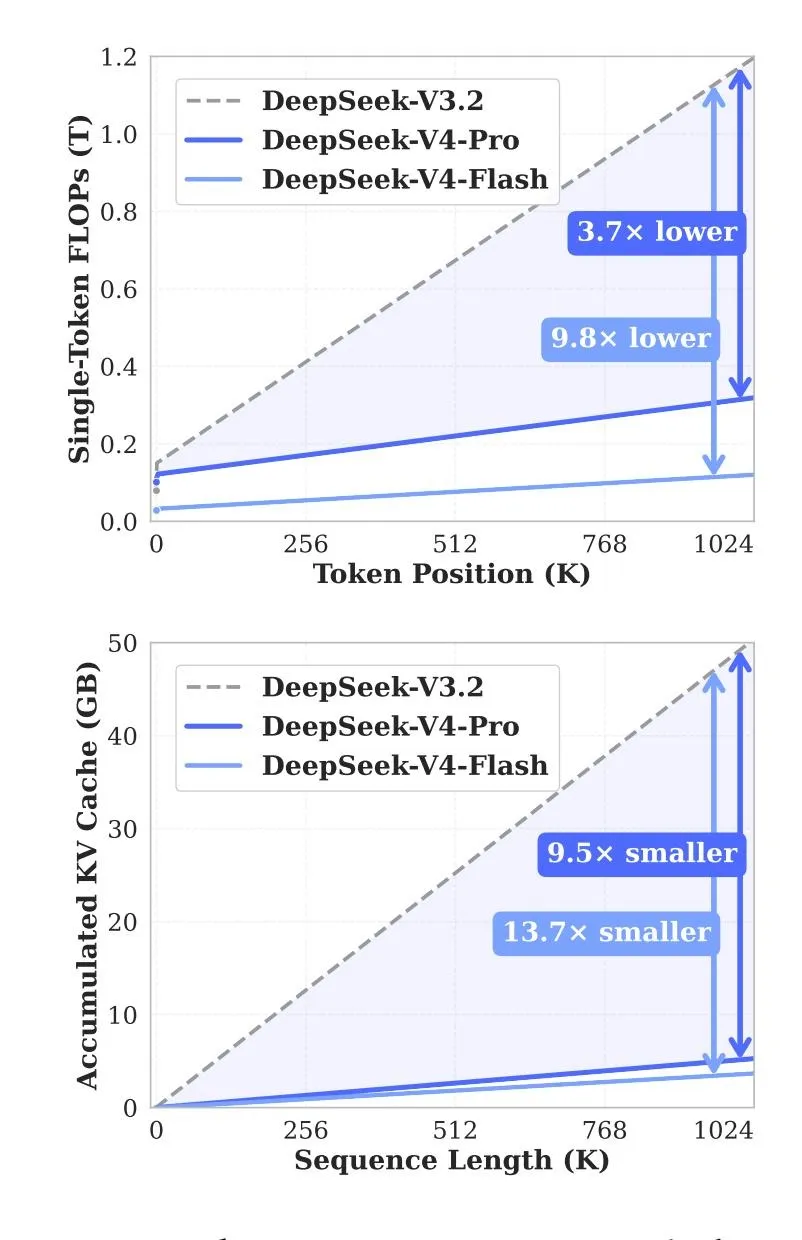

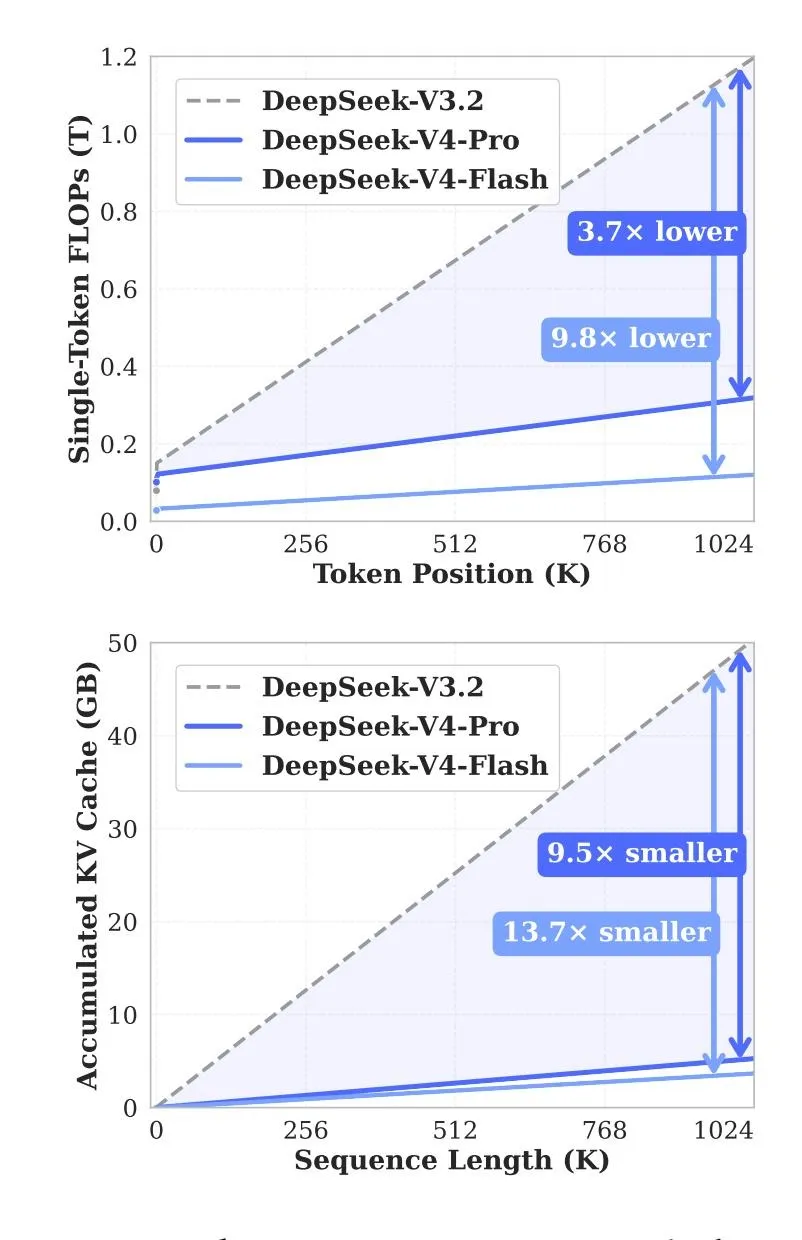

Длинный контекст стал дешевле

Ключевым отличием V4 стала оптимизация обработки длинных последовательностей. Контекстное окно в 1 млн токенов есть и у других моделей, но его использование обычно сопряжено с высокой стоимостью и задержками.

В DeepSeek заявили, что новая версия заметно снизила ресурсоемкость таких операций. По сравнению с V3.2, V4-Pro требует около 27% вычислений и 10% памяти KV-кэша при работе с максимальным контекстом. Для V4-Flash показатели составляют примерно 10% и 7% соответственно.

Команда добилась результата благодаря гибридной архитектуре внимания: два механизма сжимают данные и снижают нагрузку при работе с длинными текстами. Также использовались специальные гиперсвязи для стабильности и оптимизатор Muon для ускорения обучения.

Режимы рассуждения и агентные возможности

DeepSeek V4 поддерживает три режима рассуждений:

- Non-think — быстрые ответы на простые вопросы без дополнительного анализа.

- Think High — глубокий анализ для сложных задач и планирования.

- Think Max — максимальный режим: модель прописывает каждый шаг и проверяет все варианты.

В агентных задачах режим Max теперь сохраняет цепочку промежуточных шагов внутри одной задачи. В предыдущей версии часть такого контекста терялась при взаимодействии с пользователем.

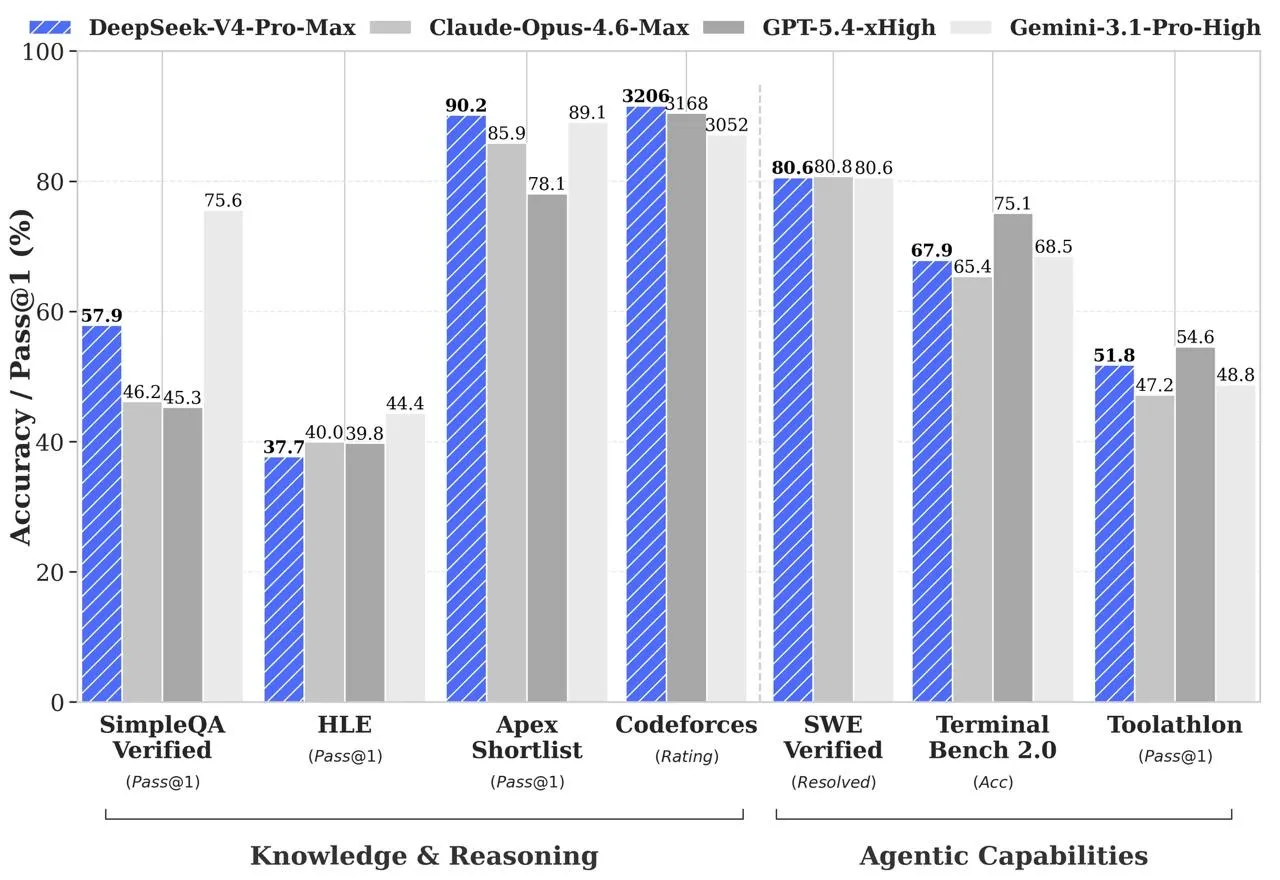

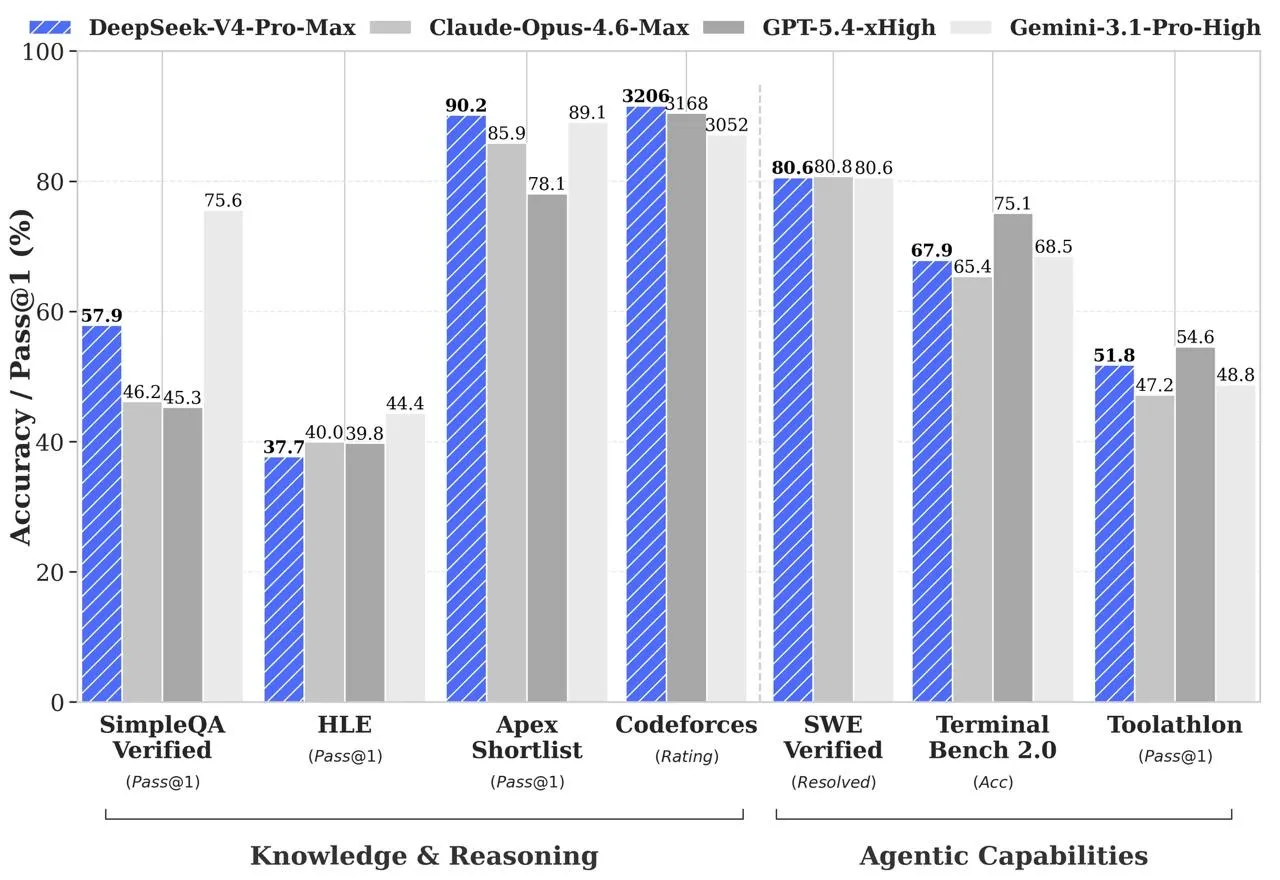

Результаты тестирования

По данным DeepSeek, флагманская версия демонстрирует результаты, сопоставимые с ведущими системами в ряде направлений:

- в задачах по программированию на Codeforces модель достигла рейтинга 3206 — 23 место среди живых программистов мира, паритет с GPT-5.4;

- в математике показала 95,2 на HMMT 2026 и 89,8 на IMOAnswerBench, опередив большинство конкурентов;

- в знаниях SimpleQA Verified — 57,9 (Opus 4.6 — 46,2, но Gemini 3.1 Pro — 75,6).

- в ризонинге модели отстают от GPT-5.4 и Gemini 3.1 Pro только на три-шесть месяцев;

- во внутреннем тесте DeepSeek, включающем задачи разработки, отладки и рефакторинга, модель достигла 67% — между Sonnet 4.5 (47%) и Opus 4.5 (70%);

- в агентных сценариях и задачах разработки V4-Pro-Max продемонстрировала 80,6% на SWE Verified и 67,9% на Terminal Bench.

V4 специально тренировали на реальных сценариях: анализ данных, отчеты, редактирование документов, поиск в интернете с итеративным использованием инструментов.

Для оценки пригодности модели в реальной разработке стартап провел внутреннее тестирование на задачах своих инженеров. В опросе 85 разработчиков и исследователей 52% заявили, что готовы использовать V4-Pro как основную модель для кодинга, еще 39% отметили, что склоняются к такому решению.

Напомним, 23 апреля компания OpenAI выпустила GPT-5.5. Модель позиционируется как «новый уровень интеллекта для реальной работы и управления агентами».

Подписывайтесь на ForkLog в социальных сетях

Telegram (основной канал) Facebook X Нашли ошибку в тексте? Выделите ее и нажмите CTRL+ENTERРассылки ForkLog: держите руку на пульсе биткоин-индустрии!

Материалы по теме

СМИ: Microsoft впервые за 51 год запустила программу добровольных увольнений

OpenAI представила флагманскую ИИ-модель GPT-5.5

OpenAI выпустила облачных ИИ-агентов для работы в команде

Google обновила чипы для ИИ и открыла доступ к платформе агентов

SpaceX предупредила о возможном коммерческом провале космических дата-центров

Конец монополии на интеллект: как алгоритмы вытесняют когнитивную элиту

Meta начала собирать данные о действиях сотрудников для обучения ИИ-агентов

OpenAI представила «думающий» генератор изображений

Экс-сотрудники Google представили ИИ для роботов с «необученными» навыками

Схожі новини